Ollama est un outil open source qui permet d’exécuter de grands modèles de langage (LLM) directement sur une machine locale.

Il est donc très utile pour les développeurs utilisant les outils IA, qu’ils soient débutants ou confirmés, ainsi que pour les entreprises soucieuses du contrôle de leurs données et de la protection de la vie privée.

En exécutant les modèles localement, vous conservez l’entière propriété de vos données et évitez les risques de sécurité potentiels liés au stockage dans le cloud, ce qui est particulièrement intéressant pour les entreprises souhaitant déployer leurs propres solutions d’IA.

Les modèles Ollama

Dans Ollama, il existe des centaines de modèles open source disponibles gratuitement à utiliser sur votre machine locale, et leur installation est très simple !

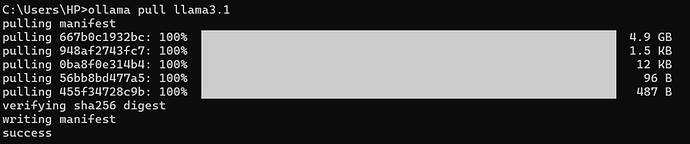

Avec une simple commande dans le terminal :

« ollama pull nom_du_modèle »

Vous pouvez installer n’importe quel modèle disponible dans Ollama.

Pour découvrir les modèles existants ou chercher en fonction de vos besoins, Ollama propose une bibliothèque complète accessible à cette adresse : Modèles Ollama

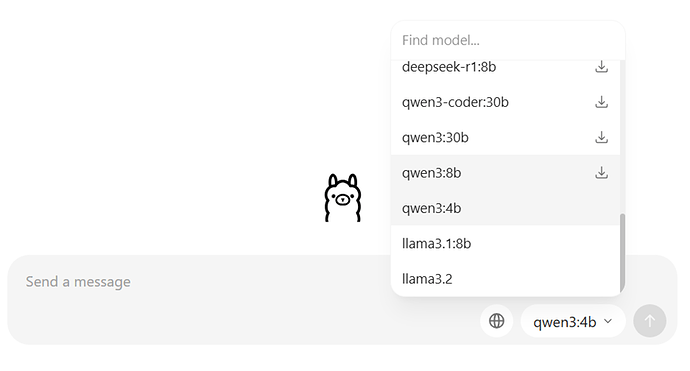

Il existe également l’interface Ollama Chat, très similaire à ChatGPT, qui vous permet d’interagir directement avec un modèle d’IA et de télécharger ou charger d’autres modèles depuis l’interface. (Download Ollama)

Pour savoir quels modèles sont déjà installés sur votre machine, il suffit d’exécuter la commande suivante :

« ollama list »

Utiliser votre modèle

Une fois votre modèle installé et votre code créé, le modèle peut répondre à vos questions et exécuter des tâches comme vous le souhaitez !

Mais attention : connaissez-vous les prérequis pour utiliser un modèle d’IA ?

Il existe des milliers de modèles disponibles, mais ils ne sont pas tous compatibles avec toutes les machines.

Chaque modèle a ses propres spécifications techniques et exigences matérielles pour fonctionner correctement. Certains nécessitent beaucoup de VRAM (GPU), de RAM ou des architectures CPU/GPU spécifiques.

Il est donc essentiel de disposer d’une bonne quantité de mémoire RAM, d’un processeur performant et, selon le modèle utilisé, d’une carte graphique adaptée avant de se lancer dans des projets d’IA complexes.

Nos tests ont révélé notamment que le modèle Llama 3.2 ne s’exécute pas sur une machine de équipe d’une mémoire de 32 Go, d’un processeur Intel i7 8e génération et d’une NVIDIA GeForce 930MX, la carte graphique n’étant pas assez performante (pas assez de vRAM).

Il est néanmoins possible d’utiliser des modèles de quantification (par exemple en Q4 ou Q5), qui permettent d’exécuter le modèle directement sur le processeur sans nécessiter une carte graphique puissante.

Pour plus d’informations sur ce procédé de quantification, vous pouvez vous référer à notre post : Grand modèle IA sur un ordinateur portable ? c'est possible grâce au procédé de quantification!

En savoir plus

Pour plus d’informations sur l’installation, la compatibilité, les intégrations et bien d’autres sujets, vous pouvez toujours consulter le site officiel d’Ollama : Ollama site web